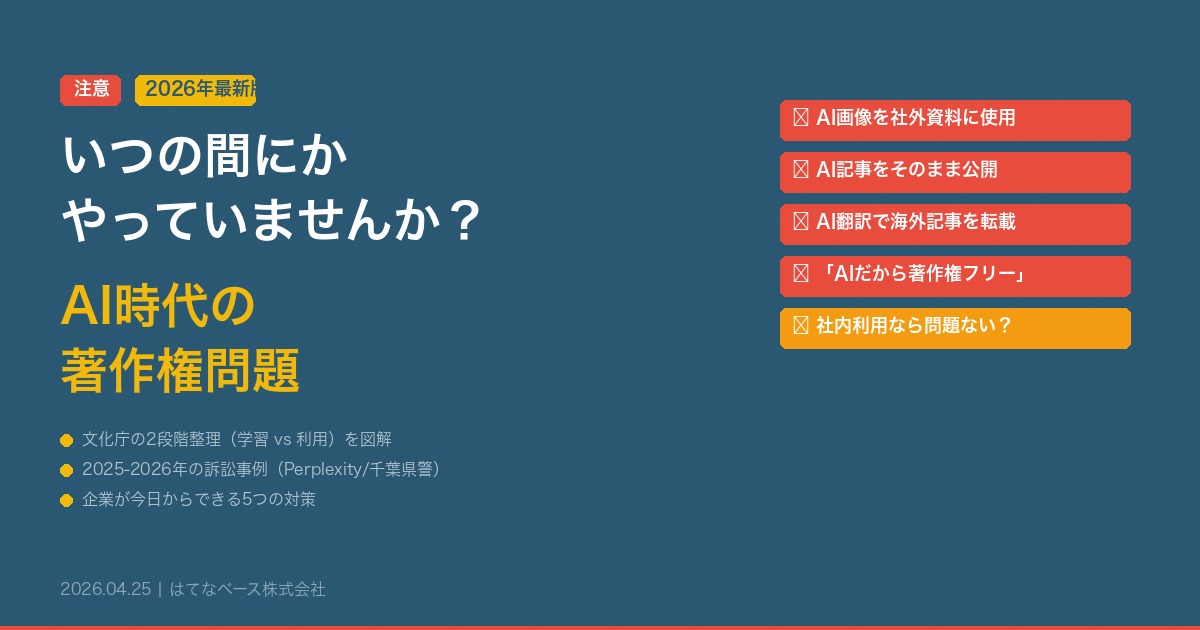

いつの間にかやってしまっていない?AI時代の著作権問題

2026年最新の訴訟事例と文化庁の2段階整理をもとに、生成AI利用で企業が直面する著作権リスクと実践的な対策を解説

「AIが作ったものだから著作権は関係ない」と思っていませんか。2025年には新聞社3社がAI企業を提訴し、千葉県警がAI画像の著作権侵害で日本初の刑事事件として書類送検に踏み切りました。「知らなかった」では済まされない時代に、企業が今日から取り組める具体的な対策と、社内ガイドラインに盛り込むべき10項目を整理しました。

1. 「いつの間にか」やってしまっている著作権リスク

生成AIは日常業務に急速に浸透しました。社内プレゼン資料の画像をChatGPTやMidjourneyで生成する。ブログ記事のドラフトをAIに書かせてそのまま公開する。海外の業界レポートをAIで翻訳して社内共有する。どれも「ちょっと便利なツールを使っただけ」という感覚で、著作権リスクを意識していない担当者がほとんどです。

しかし、これらの行為には明確な法的リスクが潜んでいます。たとえば、AIが生成した画像が既存のイラストレーターの作品に酷似していた場合、その画像を社外に公開した企業は著作権侵害で損害賠償を請求される可能性があります。2025年11月、千葉県警がAI生成画像による著作権侵害で書類送検したことは、「AIが作ったから大丈夫」という認識がもはや通用しないことを示す象徴的な事件でした。

社内で起きがちな3つのシナリオ

営業担当者が提案書用のイメージ画像をAIで生成し、クライアントに提出。生成された画像が有名イラストレーターの画風を強く反映しており、SNSで拡散されて炎上。イラストレーターが損害賠償請求を検討 — このケースでは、画像を生成したAI企業ではなく、それを業務利用した企業側が責任を負います。

マーケティング担当者がブログ記事をAIに書かせ、軽い修正だけで自社サイトに公開。記事の中に、特定の専門書やWeb記事から引用された文章がほぼそのままの形で含まれていた。原著者から「無断転載だ」と指摘を受け、記事の削除と謝罪に追い込まれる — AIは学習データの文章を部分的にそのまま出力することがあり、人間のレビューなしでの公開は大きなリスクです。

海外メディアの記事をAIで翻訳し、社内のニュースレターやブログに掲載。「翻訳しただけだから問題ない」と考えがちですが、翻訳は原著作物の翻案に該当します(著作権法第27条)。原著者の許諾なく翻訳を公開すれば、言語が違っても著作権侵害になります。

これらのシナリオに共通しているのは、担当者に悪意がないことです。「便利だから使った」「AIが作ったから問題ないと思った」という善意の行動が、法的リスクにつながっています。特に危険なのは、「自分は大丈夫」と思っている層です。日常的にAIを使いこなしている社員ほど、著作権リスクへの意識が薄くなる傾向があります。経済産業省の2025年度調査によると、生成AIを業務利用している企業のうち、著作権に関する社内ガイドラインを整備済みの企業は約15%にとどまりました。残りの85%は、組織として無防備な状態でAIを使い続けているのです。

2. 文化庁の2段階整理 — 学習と利用は別の話

AI著作権問題を正しく理解するためのカギは、文化庁が2024年3月に公表した「AIと著作権に関する考え方について」で示された「2段階の整理」にあります。多くの企業担当者が「AIだから著作権フリー」と誤解している根本原因は、この2つの段階を区別できていないことにあります。

第1段階 — AI開発・学習段階

著作権法第30条の4は、「著作物に表現された思想又は感情を自ら享受し又は他人に享受させることを目的としない場合」に著作物の利用を認めています。AI開発のために大量のテキストや画像を学習データとして読み込む行為は、この条文により原則として適法とされています。日本のこの規定は世界的に見ても寛容で、英国のように非商用目的に限定したり、EUのように著作権者のオプトアウト権を認めたりする国とは異なり、商用目的の学習も許容しています。

ただし、30条の4にも例外があります。文化庁の見解によれば、特定のクリエイターの作品のみを大量に学習させ、そのクリエイターのスタイルを模倣する目的が明確な場合は、「享受目的」に該当し、30条の4の適用外となる可能性があります。たとえば、ある漫画家の全作品だけを学習させて「その漫画家風の絵を描くAI」を作る行為は、学習段階であっても違法となりうるのです。

もう1つ注意すべきは、著作権者が技術的手段(robots.txt等)でAIクロールを拒否している場合です。この場合も30条の4の適用が制限される可能性が議論されています。実際に、多くの新聞社やメディア企業がrobots.txtでAIクロールをブロックしており、これを無視して学習データに利用すれば法的リスクが高まります。

第2段階 — 生成・利用段階

ここが最も重要なポイントです。AIが生成したテキスト・画像・音楽などを実際に利用する段階では、30条の4の特例は一切適用されません。通常の著作権法がそのまま適用されます。つまり、AI生成物が既存の著作物と「類似」しており、かつ「依拠性」(既存著作物に基づいて作られたこと)が認められれば、著作権侵害になります。

ここで企業が特に注意すべきなのは「依拠性」の判断基準です。従来の著作権法では、侵害を主張する側が「被告が原告の著作物にアクセスできた」ことを立証する必要がありました。しかしAI生成物の場合、文化庁は「AIの学習データに当該著作物が含まれていれば、利用者がその著作物を知らなくても依拠性が認められ得る」との見解を示しています。ChatGPTやClaudeの学習データにはインターネット上の膨大なテキストや画像が含まれているため、「知らなかった」という弁解は通用しにくい構造になっているのです。

この2段階の区別を正しく理解していない企業は非常に多く、「AIの学習は合法と聞いた → だからAI生成物も自由に使える」という飛躍した論理で著作権リスクを見落としています。学習が合法であることと、生成物の利用が合法であることは、まったく別の問題です。

「日本はAI学習に寛容な法制度だから、AI生成物も自由に商用利用できる」という理解は明確に誤りです。30条の4が適用されるのは学習段階のみ。生成物を営業資料、ブログ、広告、SNS投稿に使う段階では、既存著作物との類似性チェックが不可欠です。

3. 最新の訴訟事例(2025-2026年)

AI著作権をめぐる法的紛争は2025年に入って急増しました。日本国内では確定判決こそまだ出ていませんが(2026年2月時点)、複数の重要な訴訟が進行中であり、企業の実務に大きな影響を与えるものばかりです。ここでは国内外の主要な事例を整理し、各事例から企業が学ぶべき教訓を明確にします。

国内事例

読売新聞・朝日新聞・日本経済新聞の3社が、AI検索エンジン「Perplexity AI」を著作権侵害で東京地裁に提訴しました。争点は、Perplexityが新聞記事を丸ごと要約して回答に表示する行為が「引用」の範囲を超えた著作権侵害に当たるかどうかです。新聞社側は、Perplexityの回答が元記事の構成・表現を実質的に再現しており、ユーザーが元記事にアクセスする必要がなくなる(=新聞社の収益を毀損する)と主張しています。

企業への教訓 — AI要約ツールで外部記事を要約し、社内レポートや顧客向け資料に使う行為も同様のリスクを孕んでいます。「AIが要約しただけ」は免罪符にはなりません。

千葉県警がAI画像生成ツールを使って既存のイラストレーターの作品に酷似した画像を生成・販売していた個人を著作権法違反の疑いで書類送検しました。日本初のAI画像に関する刑事事件であり、「AIが生成したものだから著作権侵害にならない」という認識が法的に否定された画期的なケースです。

企業への教訓 — 民事だけでなく刑事責任のリスクもあるということです。企業が組織的にAI生成画像を商用利用し、それが既存著作物の侵害と認定された場合、法人としての責任が問われる可能性があります。罰則は10年以下の懲役もしくは1,000万円以下の罰金、法人は3億円以下の罰金です(著作権法第119条・第124条)。

海外事例

| 事件名 | 概要 | 現在のステータス |

|---|---|---|

| Getty Images vs Stability AI | Stable Diffusionの学習にGettyの画像1,200万枚以上を無断使用したとして提訴。Gettyのウォーターマークが残った生成画像が証拠に | 英国・米国で審理中 |

| NYT vs OpenAI / Microsoft | NYTの記事をChatGPTが逐語的に再現できることを立証し、学習段階と利用段階の双方で侵害を主張 | 米国で審理中 |

| Concord Music vs Anthropic | Claudeが歌詞をほぼそのまま出力する問題。音楽出版社が損害賠償を請求 | 米国で審理中 |

| Thomson Reuters vs Ross Intelligence | 法律データベースWestlawのコンテンツをAI学習に利用。フェアユースが争点に | 一部でThomson Reuters勝訴(2024年) |

海外の訴訟で注目すべきは、Getty Images訴訟で「生成画像にGettyのウォーターマークが残っていた」という事実です。これはAIが学習データをそのまま「記憶」して出力する場合があることの直接的な証拠であり、「AIは学習データを変換・抽象化しているから侵害にならない」というAI企業側の主張を弱める材料になっています。

また、NYT vs OpenAI訴訟では、特定のプロンプトを入力するとNYTの記事が数百語にわたってほぼ逐語的に再現されることが実証されました。これは「AIの出力が元の著作物に依拠している」ことの強力な証拠です。企業がChatGPTで生成したテキストをそのまま公開する場合、同様の「逐語的再現」が含まれるリスクを常に意識する必要があります。

4. AI生成物に著作権は発生するのか

著作権侵害のリスクとは逆方向の問題として、「自社がAIで生成したコンテンツは著作権で保護されるのか」という疑問があります。結論から言えば、AIが自律的に生成したコンテンツには原則として著作権が発生しません。これは、著作権法が「人間の思想又は感情の創作的表現」を保護対象としているためです。

文化庁の見解では、人間が「創作的寄与」を行った部分にのみ著作権が発生するとされています。では何が「創作的寄与」に当たるのか。「美しい風景画を描いて」というシンプルなプロンプトでは創作的寄与とは言えません。一方で、AIの出力に対して人間が大幅な修正・加筆・再構成を行った場合は、その編集部分について著作権が発生する余地があります。

この問題が企業にとって深刻なのは、「自社コンテンツを他社にコピーされても文句が言えない」状況が生まれるためです。たとえば、AIで生成したマーケティングコピーやプレゼン資料のデザインを競合他社にそっくり模倣されても、元のコンテンツに著作権がなければ差止請求も損害賠償請求もできません。

プロンプトの工夫は「創作的寄与」になるのか

「緻密なプロンプトエンジニアリングを行えば著作権が発生するのでは」という意見がありますが、現時点の法的見解ではこれは認められにくい傾向にあります。プロンプトはあくまで「指示」であり、最終的な表現を決定しているのはAIだからです。同じプロンプトでも実行するたびに異なる出力が得られることが、この論理を裏付けています。

米国著作権庁は2023年3月の「Registration Guidance」で、AIが生成した画像を含むグラフィックノベル「Zarya of the Dawn」について、「AI生成画像部分は著作権登録の対象外、人間が創作したテキストとレイアウト部分のみ登録可」との判断を示しました。この判断は日本でも参照されており、「プロンプトだけでは創作的寄与に不十分」という国際的なコンセンサスが形成されつつあります。

企業にとっての実務的な対応策は明確です。AIの出力をそのまま使うのではなく、必ず人間の手による編集・加工を加えること。これにより、少なくとも編集部分には著作権が発生し、自社コンテンツとしての法的保護が得られます。具体的には、AI生成テキストの構成変更、表現の書き換え、独自のデータや事例の追加、AI生成画像のトリミング・色調変更・要素の追加削除などが「創作的寄与」に該当する可能性が高いとされています。

AI生成物を自社コンテンツとして公開する場合、「AI生成のまま使用」と「人間が大幅に編集して使用」では法的な保護レベルがまったく異なります。AIの出力をたたき台として使い、人間が構成・表現・データを加えて仕上げる運用が、著作権の取得と侵害リスクの低減を両立させる最善策です。

5. 企業が今日からできる5つの対策

法的な整理を理解した上で、企業が具体的に何を行うべきかを5つのアクションにまとめます。これらは大企業だけでなく、従業員10名規模の中小企業でも今日から着手できるものです。

「何が許されて何が許されないか」を明文化したガイドラインを作成します。A4で2〜3ページ程度のシンプルなもので構いません。重要なのは作成することではなく、全社員に共有し、定期的に更新することです。次のセクションで具体的な10項目を示します。策定にあたっては、法務部門(または顧問弁護士)の監修を受けることを強く推奨します。日本弁護士連合会は2025年にAI著作権に関するガイドライン案を公表しており、これをベースにすると効率的です。

テキストでも画像でも、AI生成物をそのまま社外に公開することは避けてください。必ず人間が内容を精査し、編集・加工してから使用します。テキストなら構成の組み替え、事実確認、独自のデータや見解の追加。画像なら構図の調整、不自然な部分の修正、自社ブランド要素の追加。これにより著作権侵害リスクの低減と、自社コンテンツへの著作権発生の両方が期待できます。具体的な目安として、元のAI出力から30%以上を人間が書き換える(テキストの場合)ことを社内基準にしている企業もあります。

AIツールの利用規約は「生成物の商用利用」に関する条件がサービスごとに大きく異なります。ChatGPT(Plus以上)、Claude(Pro以上)、Adobe Fireflyは生成物の商用利用を明示的に許可しています。一方で、無料プランのAIツールや、利用規約に商用利用の明記がないツールは注意が必要です。さらに、Adobeの「Firefly」のように学習データにライセンス済みのストック画像のみを使用しているサービスは、著作権侵害リスクが相対的に低い選択肢です。ツール選定時には、(a)生成物の商用利用が規約上許可されているか、(b)学習データの透明性が確保されているか、(c)著作権侵害に対する補償(Indemnification)が用意されているか、の3点を確認してください。MicrosoftやGoogleは企業向けプランで著作権侵害の損害賠償を補償するプログラムを提供しています。

AI生成物を社外に公開する前に、既存著作物との類似性をチェックする習慣をつけてください。画像の場合はGoogle画像検索やTinEye(逆画像検索サービス)で類似画像がないか確認します。テキストの場合はCopyleaks、Turnitinなどのコピペチェックツールが有効です。Copyleaksは2024年からAI生成テキストの検出機能も搭載しており、月額9.99ドルから利用できます。完璧なチェックは不可能ですが、「チェックを行った」という事実自体が、万が一訴訟になった場合に「故意ではなかった」ことの証拠になります。

誰が・いつ・どのAIツールで・何を生成したかを追跡できる仕組みを整えます。ChatGPTやClaudeの会話履歴をエクスポートして保管するだけでも最低限の対応になります。より本格的には、企業向けAIツール(ChatGPT Enterprise、Claude for Business等)を導入することで管理者が全ユーザーの利用ログを一元管理できます。万が一の訴訟時に「どの担当者が・どのような意図で・何を生成したか」を説明できることは、企業の法的防御において極めて重要です。ログがなければ、社員個人の行為なのか組織的な行為なのかの線引きもできず、法人としての責任が重くなるリスクがあります。

6. 社内ガイドラインに入れるべき10項目

社内ガイドラインは、法律の専門知識がない社員でも「自分のケースはOKなのかNGなのか」を即座に判断できるものでなければ意味がありません。以下の10項目を盛り込んだガイドラインを策定することを推奨します。すべてを最初から完璧にする必要はなく、まず骨格を作って全社に共有し、運用しながら改善する方がはるかに効果的です。

| 項目 | 内容 | 判断の目安 |

|---|---|---|

| 1. 利用可能なAIツール | 社内で使用を認めるAIツールのリスト。商用利用規約の確認済みツールのみ | リスト外のツールは原則禁止 |

| 2. 社外公開前の人間レビュー義務 | AI生成物を社外に公開する場合、必ず人間が内容を確認・編集する | 「そのまま公開」は全面禁止 |

| 3. 画像生成の制限事項 | 特定のアーティスト名・ブランド名をプロンプトに含めない。実在人物の肖像を生成しない | 「〇〇風」「〇〇スタイル」もNG |

| 4. 類似性チェックの実施 | 社外公開するAI生成画像は逆画像検索、テキストはコピペチェックを実施 | チェック結果を記録として保管 |

| 5. 機密情報の入力禁止 | 社外のAIサービスに顧客データ・契約情報・未公開財務情報を入力しない | 社内RAGシステム経由は例外 |

| 6. 利用ログの保管 | どのツールで何を生成したかのログを最低2年間保管 | 企業向けプランでの一元管理が望ましい |

| 7. 著作権表示のルール | AI生成物を含むコンテンツへの著作権表示(©)の可否ルールを明確にする | AI生成部分のみのコンテンツに©は不適切 |

| 8. 社内利用と社外利用の区分 | 社内検討資料(非公開)と社外公開資料で適用するルールのレベルを分ける | 社内のみならリスクは低い(ただしゼロではない) |

| 9. インシデント対応フロー | 著作権侵害の指摘を受けた場合の初動対応(該当コンテンツの非公開化、法務への連絡等) | 24時間以内の初動を目標に |

| 10. 定期見直しスケジュール | 法改正やAI技術の進展に合わせ、最低でも半年に1回ガイドラインを見直す | 法務+IT部門の合同レビュー |

このうち特に優先度が高いのは、項目2(人間レビュー義務)と項目3(画像生成の制限事項)です。テキストは人間のレビューで改変が容易ですが、画像は「見た目が似ているかどうか」が一般人にも判断しやすく、SNSで拡散されやすいためリスクが高くなります。実際に千葉県警の書類送検案件も画像が発端でした。

項目5の機密情報入力禁止は著作権とは別の観点ですが、AI利用ガイドラインとしてはセットで整備すべき項目です。Samsung社の社員がChatGPTに社内ソースコードを入力した事件(2023年)以降、多くのグローバル企業がAI利用ガイドラインに情報セキュリティ条項を含めるようになりました。

項目9のインシデント対応フローも見落としがちです。実際に著作権者から指摘を受けた場合、初動の遅れが損害を拡大させます。「誰が・何時間以内に・何をするか」を事前に決めておくことで、パニック状態での不適切な対応を防げます。削除要請から24時間以内のコンテンツ非公開化、48時間以内の法務担当者への報告、1週間以内の原因調査と再発防止策の策定、といった時間軸を設定しておくのが実務的です。

7. はてなベースの取り組み

はてなベースでは、自社業務においてClaude・ChatGPTを含む複数の生成AIを日常的に活用しています。ブログ記事の作成、社内ドキュメントの整理、コード開発、データ分析など、用途は多岐にわたります。その上で、著作権リスクに対して以下の実践を行っています。

ブログ記事における運用ルール

はてなベースのブログ記事は、AIをドラフト生成のアシスタントとして活用していますが、最終的な品質責任は人間が担っています。具体的には、AIが出力したテキストに対して「事実確認」「構成の見直し」「独自の見解・事例の追加」「表現の調整」を行い、30%以上を人間が書き換える運用をしています。AIの出力をそのまま公開することはありません。

また、記事に使用する画像については、フリー素材サイト「ソコスト」等のライセンスが明確な素材を使用しています。AIで画像を生成して記事に使うことは、社内ルールで原則禁止としています。これは著作権リスクの回避だけでなく、生成画像特有の「不自然さ」(指が6本、テキストが読めないなど)が企業の信頼性を損なうという判断もあります。

RAG(社内データのみ参照)で著作権リスクを構造的に低減

社内向けのAI活用では、RAG(Retrieval-Augmented Generation)を積極的に導入しています。RAGとは、AIが回答を生成する際に外部のWebではなく社内データベースのみを参照する仕組みです。これにより、AIの出力が外部の著作物に依拠するリスクを構造的に低減できます。

たとえば、社内のFAQシステムやナレッジベースの構築にRAGを活用する場合、AIが参照するのは自社が作成した社内ドキュメントのみです。出力が外部著作物に類似する確率は汎用AIと比較して大幅に低くなります。また、参照元のドキュメントを追跡できるため、「この回答の根拠は何か」を明確にできることも法的リスク管理の観点から有用です。

RAGの導入は中小企業でもハードルが下がっています。kintoneやSharePointに蓄積されたドキュメントをベースにRAGシステムを構築するケースが増えており、はてなベースでもこうした導入支援を行っています。著作権リスクの「根本対策」として、外部データへの依存を減らすRAGアーキテクチャは今後ますます重要になるでしょう。

- AI生成テキストは必ず人間がレビュー・編集してから公開(編集率30%以上を目安に)

- 記事画像はライセンス明確なフリー素材を使用(AI生成画像の社外利用は原則禁止)

- 社内AI活用はRAG中心(社内データのみ参照し、外部著作物への依拠リスクを低減)

- AIツールは企業向けプランを利用(利用ログの一元管理と商用利用規約の確保)

8. よくある誤解5つ

AI著作権に関しては、メディアやSNS上で不正確な情報が広まっています。ここでは特に多い5つの誤解を取り上げ、なぜ誤りなのかを明確にします。

誤解1 「AIが作ったから著作権フリー」

これは2つの意味で誤りです。まず、AI生成物が既存著作物に類似していれば著作権侵害になります。「AIが作ったから」は免責事由にはなりません。むしろ、AIの学習データに含まれる著作物に依拠したとみなされ、侵害が認められやすくなる面すらあります。次に、「著作権フリー」という言葉が「誰でも自由に使える」という意味だとしても、AI生成物は著作権で保護されない(著作権が発生しない)だけであり、「自由に使える」とは少し意味が違います。著作権が発生しないということは、自社のAI生成コンテンツを他社がコピーしても法的に止められないということでもあるのです。

誤解2 「学習段階で合法だから利用も合法」

セクション2で詳述した通り、著作権法30条の4が適用されるのは学習段階のみです。生成・利用段階では通常の著作権法が適用されます。この2段階を混同している企業は非常に多く、「日本はAI学習に寛容だから安心」と思い込んで著作権管理を怠るケースが散見されます。学習の合法性と利用の合法性はまったく別の論点です。

誤解3 「プロンプトが独自なら著作権が発生する」

高度なプロンプトエンジニアリングを行ったとしても、それだけでAI生成物に著作権が発生するとは限りません。前述の米国著作権庁の判断(Zarya of the Dawn事件)や文化庁の見解からも、プロンプトは「指示」に過ぎず、最終的な表現を決定しているのはAIであるため、人間の「創作的寄与」とは認められにくいのが現状です。著作権を確保したい場合は、AI出力に対して人間が大幅な編集・加工を加える必要があります。

誤解4 「社内利用なら問題ない」

社内利用のリスクは社外公開より低いのは事実ですが、ゼロではありません。著作権法は「私的使用のための複製」(第30条)を認めていますが、企業内での利用は「私的使用」には該当しないとされています。社内研修資料に他社の著作物を無断でコピーして配布すれば著作権侵害になるのと同様に、AIを使って生成した他社著作物の「類似物」を社内で大量に配布する行為もリスクがあります。特に、社内で使っていたAI生成コンテンツが取引先やクライアントに共有され、結果的に社外に流出するケースは珍しくありません。

誤解5 「海外サービスだから日本法は適用されない」

OpenAI(米国)、Stability AI(英国)、Midjourney(米国)など、主要なAIサービスは海外企業が提供しています。しかし、著作権侵害の判断は「利用行為が行われた場所」で適用される法律に基づきます。日本の企業が日本国内でAI生成物を利用・公開する場合、日本の著作権法が適用されます。AIサービスのサーバーがどこにあるか、AIサービスの本社がどの国にあるかは関係ありません。さらに、ベルヌ条約により、日本で創作された著作物は条約加盟国(180か国以上)で自動的に保護され、逆に海外の著作物も日本で保護されます。「海外のAIサービスだから日本の法律は及ばない」という認識は、法的に完全な誤りです。

9. 関連記事

AI著作権問題への対策は、AIの活用方法そのものを見直すことでもあります。はてなベースのブログでは、著作権リスクを低減しつつAIを最大限活用するための関連情報を公開しています。

10. まとめ — 「知らなかった」では済まされない

2025年の新聞社3社によるPerplexity AI提訴と千葉県警の刑事事件化は、AI著作権問題が「将来の課題」ではなく「今そこにあるリスク」であることを明確にしました。企業がAIを活用するメリットは大きいですが、著作権リスクを放置したまま走り続ければ、ある日突然、訴訟通知が届く可能性があります。

本記事の内容を3つのポイントに集約します。第一に、AIの学習が合法であることと、AI生成物の利用が合法であることはまったく別の問題です(文化庁の2段階整理)。第二に、AI生成物の著作権侵害責任を負うのは、AI開発会社ではなく生成物を利用した企業・担当者自身です。第三に、著作権リスクは「AI生成物を人間が編集する」「社内ガイドラインを整備する」「利用ログを残す」といった基本動作で大幅に低減できます。

最も重要なのは「今日から始める」ことです。ガイドラインの策定、類似性チェックの導入、利用ログの記録。いずれも完璧を目指す必要はなく、まず骨格を作って運用を始め、問題が出たら改善する。この「走りながら整える」アプローチが、変化の速いAI領域では最も現実的です。

- セクション6の10項目を参考に、A4で2ページの社内ガイドライン(暫定版)を作成する — 完璧でなくて構いません。まず「ある」状態にすることが重要です

- 社外公開するAI生成コンテンツの類似性チェックを習慣にする — Google画像検索やCopyleaksを使い、既存著作物との類似がないか確認してから公開する

- AIツールの利用ログを残す仕組みを整える — 最低限、ChatGPT/Claudeの会話履歴をエクスポートして共有フォルダに保管する。企業向けプランへの移行も検討する

経理DX事業部が、業務フローへのAIエージェント導入を支援。著作権リスクを踏まえた運用設計から実装までを伴走します

社内RAG構築で外部著作物への依存を低減。散在するデータを一元化し、著作権リスクの低いAI活用基盤をつくります

「AI活用したいがデータを社外に出したくない」企業向けに、オンプレミス環境での生成AI導入を支援します

いつの間にかやってしまっていない?AI時代の著作権問題|2026年最新の訴訟事例と企業の5つの対策

最終更新 2026.04.25

関連記事

いつの間にかやってしまっていない?AI時代の著作権問題|2026年最新の訴訟事例と企業の5つの対策

いつの間にかやってしまっていない?AI時代の著作権問題 2026年最新の訴訟事例と文化庁の2段階整理をもとに、生成AI利用で企業が直面する著作権リスクと実践的な対策を解説 2026.04.25 はてなベース株式会社 この

ClaudeがSpotify・Uber・Booking.comと連携開始|200以上の外部サービスをAIから直接操作する時代へ

Claudeが「なんでも頼めるアシスタント」に進化した Spotify・Uber・Booking.comなど200以上のサービスと直接連携。その仕組みは、企業のDXにも直結する この記事のポイント 2026年4月23日、

【GitHub非エンジニア入門 5/5】組織導入と運用|権限・セキュリティ・社内浸透のコツ

GitHub 非エンジニア入門シリーズ(全5回) Part 1/5 GitHubとは何か Part 2/5 アカウント作成と最初のリポジトリ Part 3/5 編集・履歴・チーム共有 Part 4/5 AI用コンテキスト

【GitHub非エンジニア入門 4/5】AI用コンテキストをGitHubで管理する実践|CLAUDE.md・Skills・社内ナレッジを集約

GitHub 非エンジニア入門シリーズ(全5回) Part 1/5 GitHubとは何か Part 2/5 アカウント作成と最初のリポジトリ Part 3/5 編集・履歴・チーム共有 ▶ Part 4/5

【GitHub非エンジニア入門 3/5】編集・履歴・チーム共有|ブラウザだけで使うGitHubコラボレーション

GitHub 非エンジニア入門シリーズ(全5回) Part 1/5 GitHubとは何か Part 2/5 アカウント作成と最初のリポジトリ ▶ Part 3/5 編集・履歴・チーム共有(本記事) Part

【GitHub非エンジニア入門 2/5】アカウント作成と最初のリポジトリ|ブラウザだけで始めるGitHub

GitHub 非エンジニア入門シリーズ(全5回) Part 1/5 GitHubとは何か ▶ Part 2/5 アカウント作成と最初のリポジトリ(本記事) Part 3/5 編集・履歴・チーム共有 Part