「アンケートを取ったが、結局集計だけで終わった」「コールセンターのログがHDDに眠っている」「NPS(Net Promoter Score=顧客推奨度指標)を毎月計測しているが、施策につながらない」——多くの企業が、顧客の声というもっとも価値の高いデータを持て余しています。本記事では、VoC分析という言葉を初めて聞いた読者でも理解できるよう、定義から実践4ステップ、そしてAIの登場で何が変わったのかまでを、用語をひとつずつ噛み砕いて解説します。

VoC分析とは — 「顧客の声を意思決定に変えるプロセス」

VoC(Voice of Customer = お客様の声)分析 とは、アンケート・問い合わせ・SNS投稿・レビューサイトのコメントなど、企業が日々受け取る顧客の生の声を集めて分析し、商品開発や営業戦略・顧客対応の改善に活かす一連のプロセスを指します。

「顧客満足度調査」と何が違うのか、と聞かれます。満足度調査が 「数値スコアを取って傾向を測る」 ことに重点を置くのに対し、VoC 分析は 「自由記述や会話の中身から、なぜそう感じたのかを読み解く」 ところまで踏み込みます。スコアの裏にある理由を取り出して、施策に変換するのがゴールです。

📖 用語補足:CX / NPS / CSAT

CX(Customer Experience/顧客体験):商品の購入前から購入後まで、顧客が企業と接するすべての場面で感じる体験の総体。/NPS(Net Promoter Score):「この商品を友人に勧めたいか」を 0〜10 で聞き、推奨者の割合から批判者を引いた指標。0〜100 のスコアになる。/CSAT(Customer Satisfaction):個別の体験に対する満足度。たとえば「問い合わせ対応に満足したか」など。VoC 分析は、これら指標の数値を裏付ける「定性データ」を扱う領域と理解するとわかりやすい。

なぜ今、VoC分析が再注目されているのか

VoC 分析というコンセプト自体は 1990 年代から存在します。にもかかわらず、ここ 2〜3 年で再び注目されるようになった理由は明確です。LLM(Large Language Model = 大規模言語モデル)の登場で、これまで手作業に頼っていた「自由記述の読解」が自動化できるようになったからです。

代表的な LLM は OpenAI の GPT、Anthropic の Claude、Google の Gemini など。これらは「アンケート1万件の自由記述を全部読んで、共通する不満を5つに整理して」といった依頼に、数分〜数時間で答えてくれます。以前ならリサーチ会社に外注して数百万円・1ヶ月かかった仕事です。

📖 用語補足:LLMとは?

LLM(Large Language Model) は、大量の文章を学習して人間の言葉を理解・生成できる AI モデル。ChatGPT や Claude の中身はこの LLM。VoC 分析の文脈では「文章を読んで意味を取り、分類できる AI」と理解すれば十分です。

VoCのデータソース — 社内にすでにある『声』6種

「うちには顧客の声を集める仕組みがない」と諦める前に、社内のどこに既に声が貯まっているかを棚卸ししてみてください。多くの場合、以下の 6 種類のうち少なくとも 2〜3 種類は既に蓄積されています。

| ① 顧客アンケート(自由記述欄) | 「ご意見・ご感想をお聞かせください」欄 | ★★★ 高(テキスト形式で取り出しやすい) |

| ② NPSコメント | 推奨度の理由を聞く自由記述 | ★★★ 高(短文で構造化しやすい) |

| ③ コールセンターログ | 通話の文字起こし or オペレーターメモ | ★★ 中(音声認識/個人情報の扱い注意) |

| ④ チャットサポートログ | Webチャット・LINE・メールの問い合わせ | ★★★ 高(最初からテキスト) |

| ⑤ レビューサイト | Google/App Store/Amazon/食べログ等 | ★★ 中(スクレイピング規約・著作権注意) |

| ⑥ SNS投稿 | X/Instagram/TikTok の自社言及 | ★ 低(ノイズが多く、文脈把握が難しい) |

最初に着手すべきは ①〜④ の社内データです。⑤ ⑥ は ROI(投資対効果)が読みづらい上に法的グレーゾーンも多く、入門段階で手を出すと挫折しがち。「もう持っているデータから始める」が VoC 分析のセオリーです。

VoC分析の4ステップ — 収集 → 構造化 → 分析 → 施策

VoC 分析は、どこから手を付けても挫折します。順序を守ることが何より重要です。

ステップ1:収集(Collection)

前章の 6 種類から 1 つだけ 選んで、過去 6ヶ月〜1年分の生データを CSV/スプレッドシート/JSON 形式で取り出します。最初から全ソースを統合しようとすると、永遠に立ち上がりません。アンケート自由記述を 500 件、コールセンターログを 1,000 件——この粒度で十分です。

ステップ2:構造化(Structuring)

生の声を、機械が処理できる形に整える段階です。具体的には、個人情報・誤字脱字・絵文字・連投を クレンジング(不要要素の除去) し、「不満」「賞賛」「要望」「質問」などタグを付け、商品名・サービス名で分類します。ここで全件を完璧に整える必要はなく、サンプル 100 件で型を作るのが現実的です。

📖 用語補足:データクレンジング

データクレンジング(Data Cleansing) とは、データから誤り・重複・欠損・ノイズを取り除いて分析に使える状態にする作業のこと。VoC では「Tel:090-...」のような個人情報マスキング、改行コードの統一、絵文字除去などが該当します。

ステップ3:分析(Analysis)

ここで AI が一気に効きます。LLM に「以下の声を 5 つのテーマに分類して、テーマごとに件数と代表コメントを抜き出して」と依頼すれば、数分でクラスタリング(後述)された一覧が返ってきます。重要なのは、「AIが出した分類を、人が必ず1度レビューする」こと。AI は「幻覚(ハルシネーション/hallucination)」と呼ばれる、実在しない要約を作り出す癖があるためです。

📖 用語補足:クラスタリングとハルシネーション

クラスタリング(Clustering):似たもの同士を自動でグループにまとめる手法。「価格への不満」「使い方がわからない」「サポートが遅い」のように、似た声を1つの塊にする。/ハルシネーション(Hallucination):LLM が事実に基づかない情報を、もっともらしく出力してしまう現象。「お客様からこんな声がありました」と AI が言っても、実際にはそんなコメントは存在しないことがある。必ず原文と照合するのが鉄則。

ステップ4:施策接続(Action)

VoC 分析でいちばん抜けるのが、この最後のステップです。分析結果がそのままレポートで終わってしまい、「で、誰が、何を変えるのか」が誰にも引き継がれない。「テーマ → 担当部署 → 期限 → 効果測定指標」を 1 枚のシートにするだけで、施策化は劇的に進みます。

従来手法 vs AI活用 — 何が変わったか

「これまでも VoC は分析されてきたのでは?」という疑問に、定量で答えます。

| 1万件の自由記述を分類する時間 | リサーチャー数名で 4〜6 週間 | AIで 2〜3 時間 + 人レビュー半日 |

| コスト | 外注で 200〜500万円 | AI 利用料 数千〜数万円 + 内製 |

| 分類の粒度 | 粗い(5〜10 テーマ) | 細かい(50〜100 サブテーマも可能) |

| 再分析 | もう一度外注が必要 | プロンプトを変えて即再実行 |

| 感情の判定 | リサーチャーの主観 | 感情分析モデルで自動スコア化 |

差は 「速度」「コスト」「再現性」 の 3 軸で 1〜2 桁あります。これが、VoC 分析が AI 時代に再注目された最大の理由です。

VoC分析の落とし穴 — 入門者が必ず踏む4つ

AI で楽になった一方、新しい落とし穴も生まれています。導入前に必ず認識しておくべき 4 つです。

落とし穴①:声の大きい少数派バイアス

アンケート自由記述に答える人、SNS で発信する人、レビューを書く人は、全顧客のうち極端に少数で、しかも感情が振り切れた層です。この声をそのまま「顧客全体の意見」と解釈すると判断を誤ります。「沈黙する大多数」の存在を常に意識する必要があります。

落とし穴②:感情ノイズで本質を見失う

「最悪です」「使えない」といった強い感情語が並ぶと、それだけで「重大事案」と勘違いしがち。感情の強度と、改善の優先順位は別軸です。AI による感情分析(Sentiment Analysis)の結果は補助情報として使い、件数 × 影響範囲で優先度をつけるのが正解です。

落とし穴③:分析が「レポートで終わる」

前述のステップ4。美しい分析資料が PowerPoint に残っているだけで、誰の行動も変わっていない——これは現場で最も頻発する失敗パターン。「分析の質より、施策接続の仕組みづくり」を先に整えることをお勧めします。

落とし穴④:AI幻覚を信じ込む

LLM が「お客様の25%が解約を検討しています」と言ったとき、それは実際に集計した数字なのか、AI が「もっともらしく作った数字」なのかを、人が必ず原文で照合する必要があります。1件でも「これは原文にない」が混じった瞬間、レポート全体の信頼が崩れます。

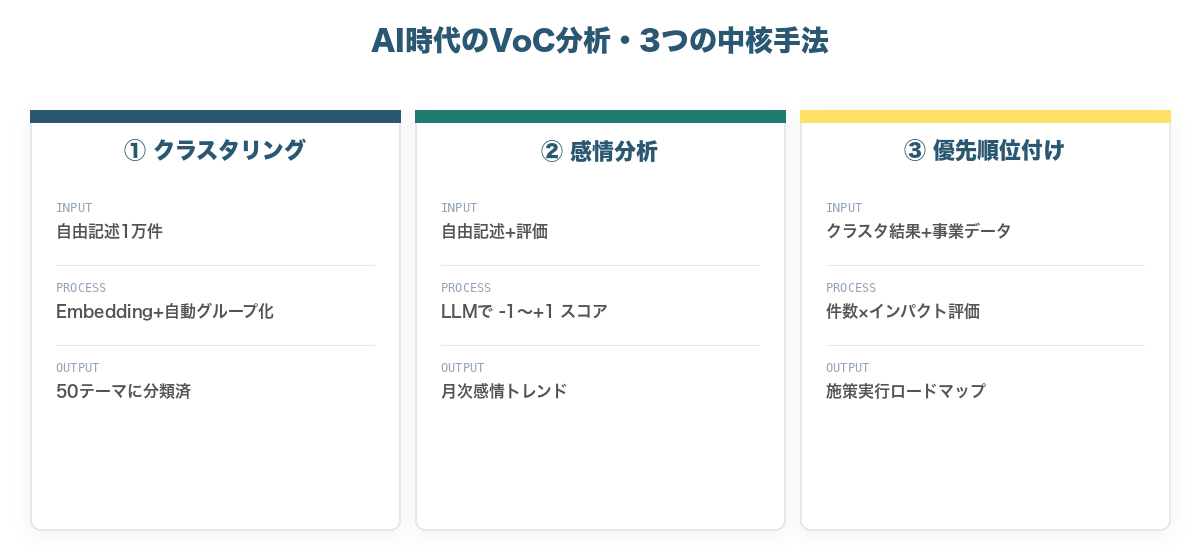

AI時代のVoC分析実践 — 3つの中核手法

「収集→構造化→分析」のうち、AI で劇的に変わるのは「分析」部分。代表的な 3 つの手法を、用語の意味とともに整理します。

手法①:クラスタリング(自動グルーピング)

意味の似た声を、自動で同じグループに集める手法。たとえば「価格が高い」「もう少し安くなれば」「コスパが悪い」は、表現は違っても同じ「価格懸念」クラスタとしてまとめられます。技術的にはEmbedding(エンベディング = 文章を数値ベクトルに変換する技術)を使い、ベクトル空間上で近い文同士をくっつけます。

手法②:感情分析(Sentiment Analysis)

ポジティブ/ネガティブ/中立を文ごとにスコア化する手法。LLM に「以下の声を -1(強い不満)〜 +1(強い満足)でスコアして」と頼むだけで、月次の感情トレンドが見えるようになります。商品リニューアル前後でスコアがどう動いたか、を可視化するのに最適です。

手法③:優先順位付け(コンジョイント風/インパクト × 件数)

クラスタリングで集めたテーマを、「件数」と「事業インパクト」の2軸でマッピングします。件数が多くても解約に直結しないテーマより、件数は少ないが解約理由になっているテーマを優先する——この判断は AI ではなく、人が事業文脈で行う必要があります。AI は素材を揃え、人が決める、が黄金比です。

📖 用語補足:Embedding と コンジョイント分析

Embedding(エンベディング):文章・画像などを「数値の並び(ベクトル)」に変換する技術。意味が近い文章はベクトル空間上で近くに配置される。検索・分類・クラスタリングの土台。/コンジョイント分析:本来は「複数の属性の組み合わせから、顧客がどの属性をどれくらい重視するか」を統計的に解く手法。本記事では厳密な意味でなく、「複数軸でテーマを順位づける」という比喩で使用。

はてなベースのVoC分析支援 — 事例とアプローチ

はてなベース株式会社は、AI を活用した VoC 分析を多数の企業で支援しています。具体的なアプローチは下記のとおりです。

- スピード重視のスポット分析 — 自由記述 1,000〜10,000 件を 1〜2 週間で要約・分類・施策提案までワンセットで納品

- 継続運用のためのテンプレ整備 — クライアント社内でも回るよう、プロンプト・分析ワークフロー・レポート雛形を整備して引き渡し

- ガバナンス対応 — 顧客情報の扱いに敏感な業界向けに、オンプレ環境・社内 LLM(Claude エンタープライズ/オンプレ Llama 等)での実装を選択肢として提示

- 部門連携設計 — 分析結果を CS / マーケ / プロダクトに渡す業務フローの設計まで一緒に作り込む(「分析だけ」で終わらせない)

「アンケートが溜まっているが、何から始めればいいかわからない」「コールセンターのログを活用したいが、個人情報の扱いが心配」——そんな状態でも、まずは現状の声の在庫を棚卸しするところから一緒に着手します。